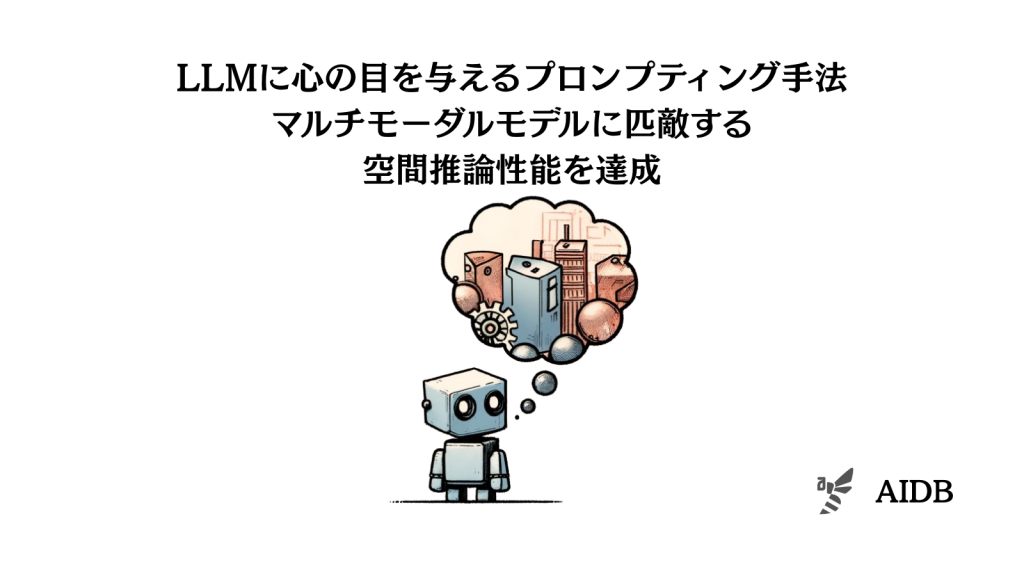

研究者らは、LLMに「心の目」を授けるプロンプト手法を考案しました。

実験の結果、LLMの空間推論能力(物体の位置関係や動きを理解し、推論する能力)が大幅に向上することが示されています。

背景

LLMにおいて「空間推論」の能力についてはあまり研究が進んでいないのが現状です。空間推論とは、物体の位置関係や動きを理解し、推論する能力のことを指します。

一方で人間は、言語だけでなく、視覚情報から抽象的な表現を作り出したり、見えないものを想像したりする「心の目」と呼ばれるような認知能力を持っています。研究チームは、LLMにも同様の能力があるのではないかと考え、新しいプロンプティング手法を開発しました。

今回考案された手法は、LLMに推論の途中経過を可視化するよう促して追跡を可能にします。LLMは推論ステップごとに心の目でイメージを生成し、次のステップに活かすことができます。また、ゼロショットプロンプティングを採用しており、外部ツールや人手の入力に頼る必要がありません。(なおゼロショットプロンプティングとは、学習済みのモデルに対して、タスクの説明だけを与えて推論させる手法です。)

実験の結果、これを適用することでLLMの空間推論能力が大幅に向上することが明らかになりました。

以下で詳しく紹介します。