スマホアプリなどで自然に会話するアシスタントを実装するための言語モデル技術をAppleが研究しています。

今回研究者らが開発したモデルは、スクリーン上の情報を理解するタスクをGPT-4以上の性能で実行でき、さらに端末上で動くとされています。

参照論文情報

- タイトル:ReALM: Reference Resolution As Language Modeling

- 著者:Joel Ruben Antony Moniz, Soundarya Krishnan, Melis Ozyildirim, Prathamesh Saraf, Halim Cagri Ates, Yuan Zhang, Hong Yu, Nidhi Rajshree

- 所属:Apple

背景

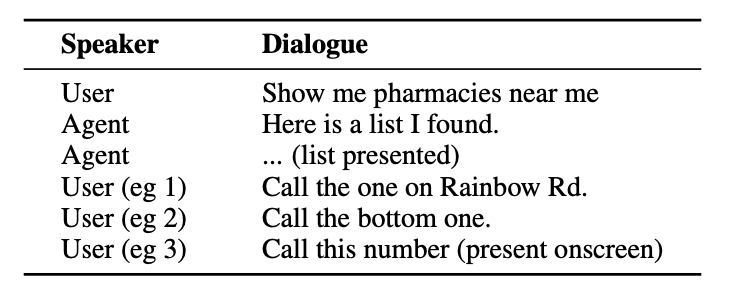

人間の会話では、「それ」「あれ」「ここ」のような曖昧な言葉がよく使われます。前提が省略されていると意味が分かりませんが、文脈を把握していれば内容は伝わります。

AIが、人間のように「それ」「あれ」「ここ」が何を指しているのかを特定するタスクを「参照問題」と言います。

参照問題タスクの能力が求められる場面はいくつか考えられます。

例えば、もしモバイルデバイス上のアシスタントがユーザーと同じように画面上の情報を把握することができるならどうでしょうか。究極的にはハンズフリーの状態で指示を音声で理解して、自由自在にデバイスを操作できるようになるかもしれません。

Appleの研究者らはこの可能性に対して考えを深めることにしました。

なお、彼らは参照問題タスクをこなすことを参照解決(Reference Resolution)と呼んでいます。

現状の会話型アシスタントは、画面上の文脈や参照情報を把握することがないため、ユーザーから「それ」「あれ」「ここ」と言われても指示を理解したり会話を続けることができません。

つまり、ユーザーはスマートフォンの画面を見ながら「それ」について話したいし聞きたい、しかし現在スマホ上のアシスタントは「それ」と言われただけでは分からない、ということです。

従来の技術では、画面情報を用いた参照問題タスクを高性能に行うことは叶いませんでした。しかし、LLMなら、エンドツーエンドで高品質な参照体験をもたらす可能性があります。

そこでAppleの研究者らは今回、参照問題タスクの解決に特化した、モバイル端末上で動くほど小さなモデルの開発を試みました。