企業がRAGを行う上での参考になるテクニックを研究している事例を紹介します。

企業が独自のデータをRAGで参照したい場合、検索精度を向上させるのがネックになります。そこで文書を小さな「原子」単位に分け、それをもとにした質問でベクトルデータベースを作成する方法が考案されました。この方法で、ユーザーの探したい内容と文書の中身がより正確に合うようになるとのことです。

本記事では、手法の詳しい内容や実験の結果、そして会社の知識管理や顧客サポートにどのような影響があるかについて紹介します。

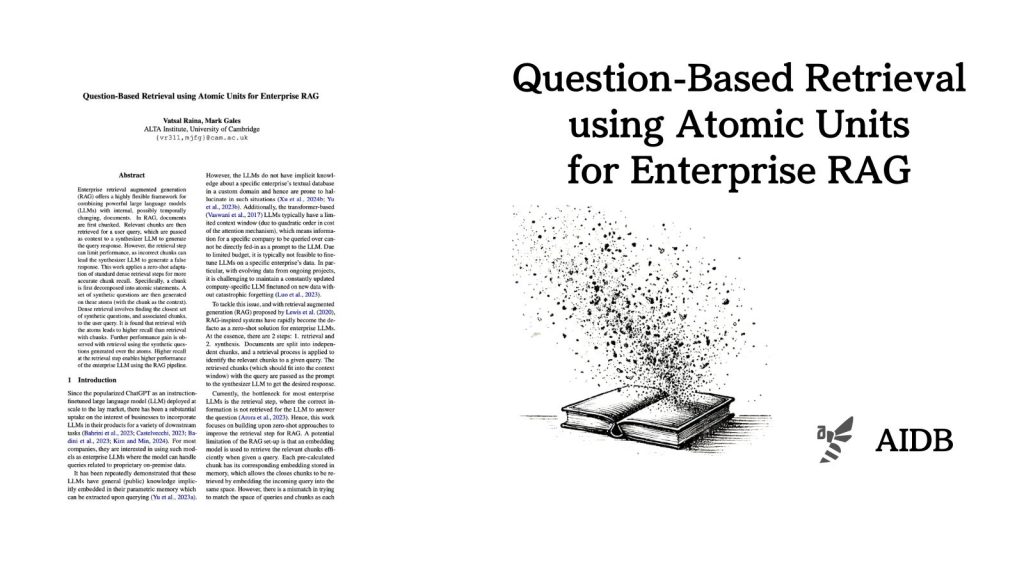

参照論文情報

- タイトル:Question-Based Retrieval using Atomic Units for Enterprise RAG

- 著者:Vatsal Raina, Mark Gales

- 所属:ALTA Institute, University of Cambridge

背景

最近は、多くの企業が自社の内部文書を活用するためにLLMを使う取り組みを始めています。いわゆる企業向けRAGシステムの開発です。RAGは、検索対象の文書を小さく(チャンクに)分け、ユーザーが欲しい内容に関係するチャンクを探し出し、それをLLMに渡して回答を作る技術です。

ところが、RAGには問題点があります。適切なチャンクを選べないとLLMが間違った答えを出してしまうことがあるという点です。この問題を解決するためのアプローチが探求されています。

一般的な方法では、ユーザーの質問と文書のチャンクを直接比べています。しかし、1つのチャンクにはたくさんの情報が含まれているため、うまく合う情報を見つけるのが難しい場合があります。

そこで今回、チャンクをさらに小さな「原子」という単位に分けることが提案されています。そして、その原子をもとにした質問を作成することもポイントです。検索する際には、ユーザーのクエリに最も近い質問と、それに関連するチャンクを見つけ出すという流れになります。

この方法は、会社のみが持っている情報にも使えるのが大切なポイントです。LLMのチューニングなど特殊な工夫は必要ありません。

RAGを改善する研究は今までもありましたが、多くはユーザーの質問の書き方を工夫するものでした。一方、この研究では文書の表し方を工夫することで、より効果的な検索ができるようにしています。

実験の結果、本手法は一般的なRAGよりも良い検索性能を示すことがわかりました。

以下で手法の詳細や実験結果を詳しく紹介します。