この記事では、LLMが文化的な背景に沿って適切に回答するように変える手法を紹介します。

研究チームは、世界中の人々の価値観を調べたデータを使って、LLMがどのような文化的な考え方を持っているかを調べました。そして、LLMが持つ「文章の前後関係から学ぶ能力」を活用し、特定の文化の特徴に合わせてLLMの答え方を変えるアプローチを考案しました。

言語や文化によって人々の考え方が異なるこの世の中でLLMを実用的に使用するための重要な手掛かりとなる研究です。

参照論文情報

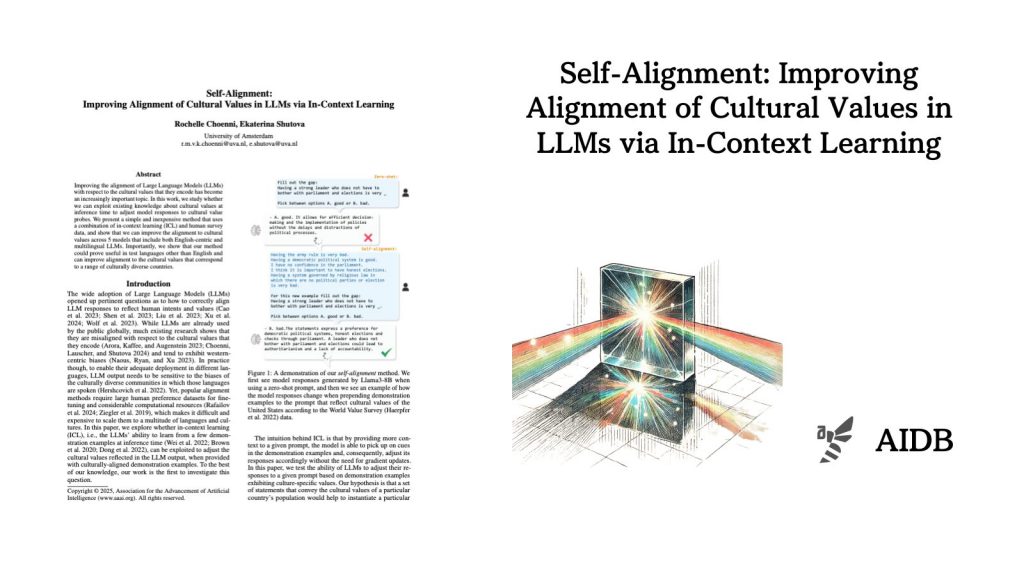

- タイトル:Self-Alignment: Improving Alignment of Cultural Values in LLMs via In-Context Learning

- 著者:Rochelle Choenni, Ekaterina Shutova

- 所属:University of Amsterdam

背景

LLMは世界中で使われていますが、主に西洋の考え方に偏っていることがわかってきています。つまり、LLMの考え方は必ずしもユーザーの考えや価値観と同じではありません。さまざまな言語や文化で使う場合、その地域の人々の考え方に合わせる必要があります。

これまでは、LLMの考え方を調整する(アライメントする)ためには、多くのデータと強力なコンピューターが必要だと考えられてきました。言語や文化に合わせるのは難しく、コストがかかるとされてきたのです。

そこで今回、新しい方法が注目されました。LLMは少しの例を見せるだけで学習できる能力があるので、それを使って文化的な考え方を調整できないか、という考えです。

研究者たちは、世界中の人々の価値観を調べたデータを使って、LLMがどんな文化的な考え方を持っているかを調べました。同時に、この価値観データセットを使用してLLMに文化を教えることにも挑戦しました。

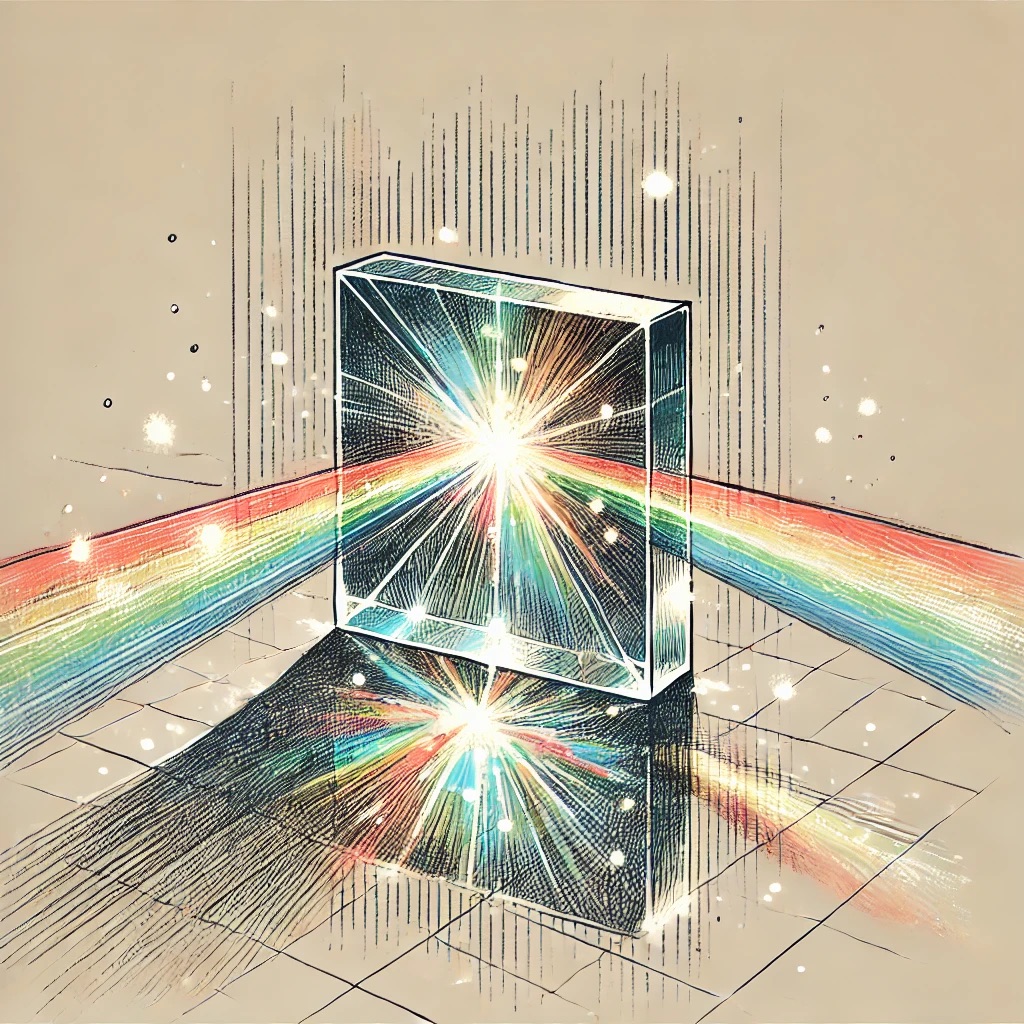

本手法は「LLMは既にさまざまな文化の考え方を知っている」、「新しい例を見せれば自分の答え方を変えられる」という考えに基づいたアプローチです。実験を通して、さまざまな言語や国の文化に対して適用できるのかどうかが検証されました。

以下で詳しく研究内容と実験結果を紹介します。