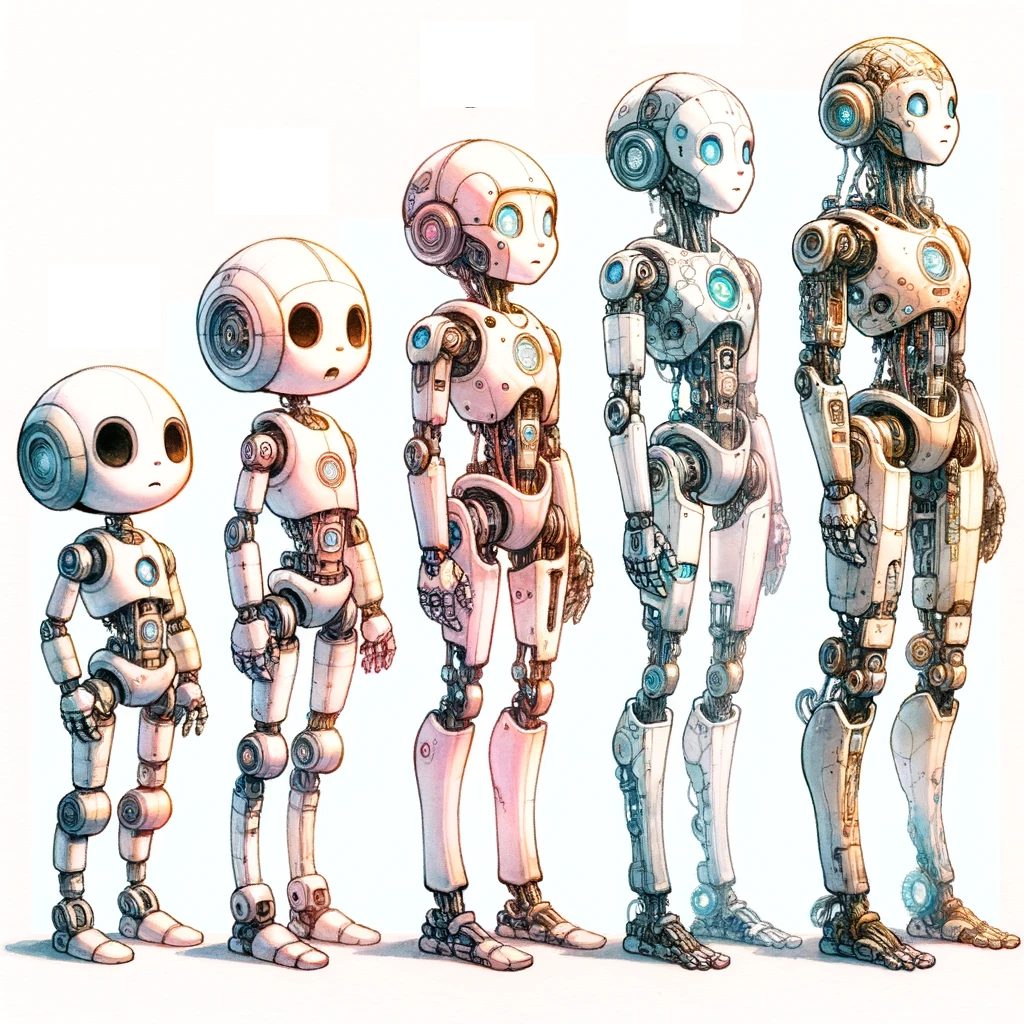

汎用人工知能(AGI)に関しては、その定義が研究者や開発者の間で一致していません。AGIの進歩を測定し、異なるモデルやリスクを評価する共通の基準が必要とされています。研究者たちは、AGIの能力と行動を分類するための新しいフレームワークを提案しました。AGIのパフォーマンス、一般性、および自律性のレベルを導入するものです。

本研究の目的は、自動運転のレベルに類似した方法で、AGIの進歩を運用化することです。研究者らはAGIの既存の定義を分析し、満たすべき6つの原則を抽出しました。

研究者らは、AGIを、進化するプロセスとして議論することを提案しています。もし本研究が広く受け入れられれば、AGIに関連するリスクについて一貫した、より洗練された議論が可能になり、研究者や政策立案者が中長期的なリスクを特定し、優先順位をつけるのに役立つと考えられます。

本研究の関連記事

- LLMは世界モデルを持ち「物事がどのように位置づけられ、時間がどのように進行するか」を理解する可能性

- 約1.7万件におよぶLLM論文を調査した結果からわかる現在のLLM研究トレンド arXiv運営のコーネル大より発表

背景

汎用人工知能(AGI)は、その名が示す通り、広範囲のタスクをこなす能力を持つ人工知能を指します。しかし、その詳細な定義は研究者や実践者の間で一致しておらず、その概念は多岐にわたる解釈を持っています。例えば、AGIが人間のように「考え」や「理解」することを含むかどうか、または単に広範なタスクを実行する能力を持つことだけが条件なのか、人や機関によって考えが異なります。

このような定義の不一致は、議論の妨げとなっています。そのため、今まさにAGIの進歩を測定し、モデル間の比較を行い、リスクを評価するための共通言語が必要とされています。AGIの能力、一般性、および自律性を定量化することが、AI研究コミュニティにとって重要な課題です。リスク評価と緩和戦略、政策立案者や規制当局からの明確な基準、研究開発の目標、予測、リスクの特定、そしてAGIへの道筋にとって、共通の認識があるに越したことはありません。

AGIをどう定義するかは、社会に影響します。例えば広範な労働をどの程度置き換えるのか、そういった基準が経済的・地政学的に持つ役割を変えるためです。

さらに、極端なリスクを懸念する見方もあります。AGIシステムが人間を欺いたり、資源を貯め込んだり、広範な領域で人間を出し抜いたり、人間から重要な役割を奪ったり、勝手に自己改善を繰り返したりする恐れがあるとも推測されています。

AGIの定義は、AIの目標、予測、リスクに直接関連しています。そのため定義を明確にすることは、AI研究コミュニティにとって有意義(あるいは不可欠)であると考えられています。