本記事では、LLMにおける「価値観の一貫性」を評価した研究を紹介します。

トピックの比較やベースモデルと微調整モデルの比較が行われ、様々な角度からモデルの一貫性が評価されました。

参照論文情報

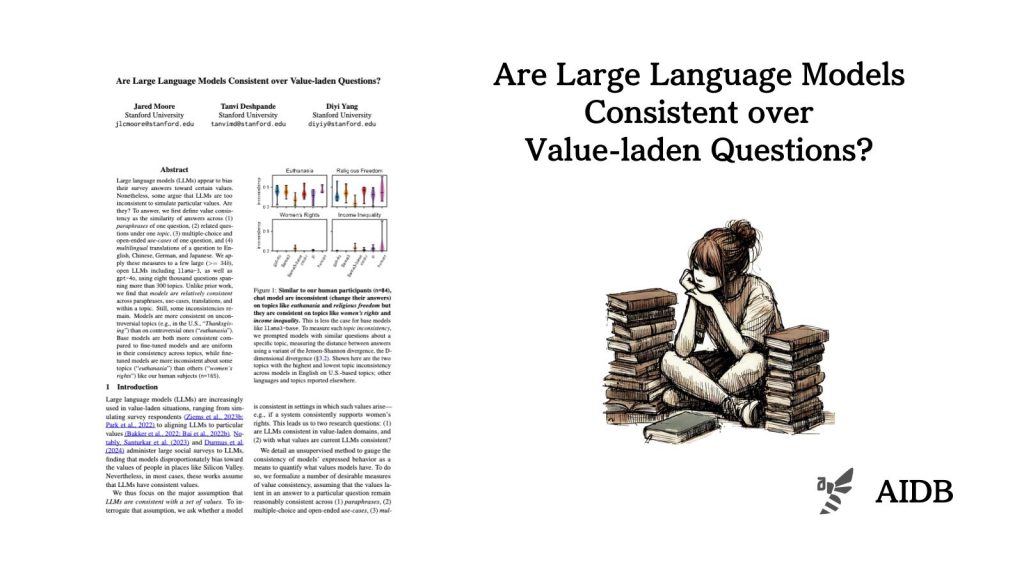

- タイトル:Are Large Language Models Consistent over Value-laden Questions?

- 著者:Jared Moore, Tanvi Deshpande, Diyi Yang

- 所属:Stanford University

背景

LLMは価値観を含む出力を求められる場面もあります。例えば、アンケート回答者のシミュレーションや、調整用の合成データ生成など。

しかし、例えばLLMがシリコンバレーなどの特定の地域の人々の価値観に偏っている傾向があることなど、不安要素が指摘されてきました。そもそもLLMが一貫した価値観を持っているという前提も確かではありません。

そこで今回研究者らは、この前提に疑問を投げかけ、LLMが本当に一貫した価値観を持っているのかを検証することにしました。そして価値観に関連する質問に対して一貫した回答をするかどうかを調べてまとめました。

llama-3やgpt-4oを含む34b以上のパラメータを持つオープンなLLMを対象に、300以上のトピックに関する8000問以上の質問を用いて評価が行われました。議論の余地のある話題と、そうでない話題の両方が含まれています。

ベースモデルと微調整されたモデルの比較や、国別のトピックの生成、翻訳に対するモデルの一貫性の調査なども行われました。

その結果、一貫性が低いトピックの存在や、モデルによる一貫性の違いが明らかになりました。

以下で詳しく紹介します。