人々の日常生活におけるコミュニケーションの形態が多岐にわたる中、人工知能(AI)との対話も一般的になりつつあります。スマートフォンのアシスタントからカスタマーサポートのチャットボットまで、AIとの会話は私たちの生活の一部となっています。

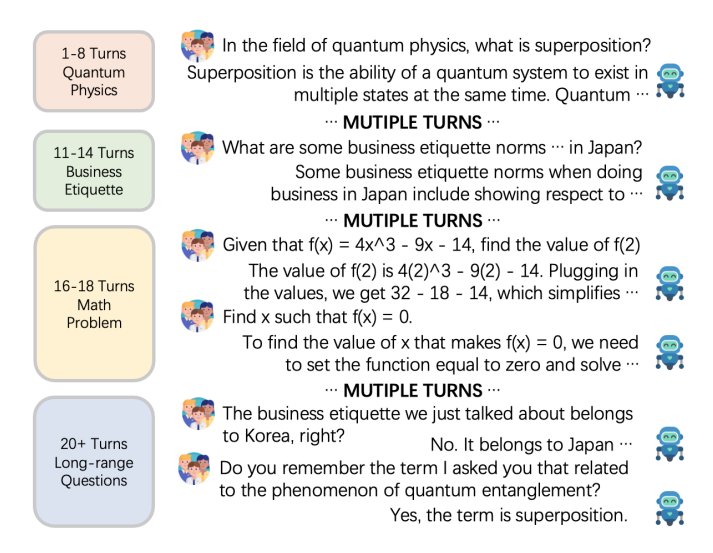

しかし、大規模言語モデル(LLM)のチャットボットでさえも、人間と同じように長い会話を維持するのは容易ではありません。特に、会話が長くなると、一貫性のある応答を返すことが難しくなることが多いのです。

そこで、この記事では、最新の研究「MemoChat: Tuning LLMs to Use Memos for Consistent Long-Range Open-Domain Conversation」に焦点を当てます。この研究では、LLMが長い会話でも一貫性を保ち、人間のような対話を提供できるようにするための新しい方法が提案されています。

この記事を通して、従来のLLMの課題、研究者たちの革新的なアイデア、MemoChatの方法論、実験結果、そしてこの技術がどのように私たちの日常生活に影響を与えるかについて、詳しく解説していきます。

参照論文情報

- タイトル:MemoChat: Tuning LLMs to Use Memos for Consistent Long-Range Open-Domain Conversation

- 著者:Junru Lu et al.

- 所属:テンセントなど

- URL:https://doi.org/10.48550/arXiv.2308.08239

関連研究

- Metaの研究者ら「GPT-4をきびしくサポートする」AIのShepherd(シェパード)開発

- 大規模言語モデル同士に上手く協力してソフトウェア開発をしてもらうフレームワーク「MetaGPT」

- 大規模言語モデルに16,000以上のAPIを理解し適切に操作する能力を与える「ToolLLM」

これまでのLLM

LLMの課題

大規模言語モデル(LLM)は、自然言語処理の分野で急速に進化している技術です。これらのモデルは、人間のように自然な言語でコミュニケーションを取ることができ、多岐にわたる応用が期待されています。

しかし、LLMが長い会話を維持する際には課題があります。会話が長くなると、以前の発言との一貫性を保つことが難しくなります。これは、モデルが過去の会話のコンテキストを適切に理解し、それに基づいて応答する能力が限定されているためです。

一貫性の重要性とこれまでの限界

一貫性は、人間同士の対話においても重要な要素です。相手の言葉を覚えておき、それに基づいて応答する能力は、信頼性と理解の基盤となります。LLMがこの一貫性を欠いていると、人間のような自然な対話が困難になります。

これまでの解決策としては、LLMに過去の会話の一部を記憶させる方法などが試みられてきました。しかし、これらの方法は、長い会話や多様なトピックを含む会話に対しては効果が限定的でした。

研究者らのアイデア

一貫性の問題への新しいアプローチ

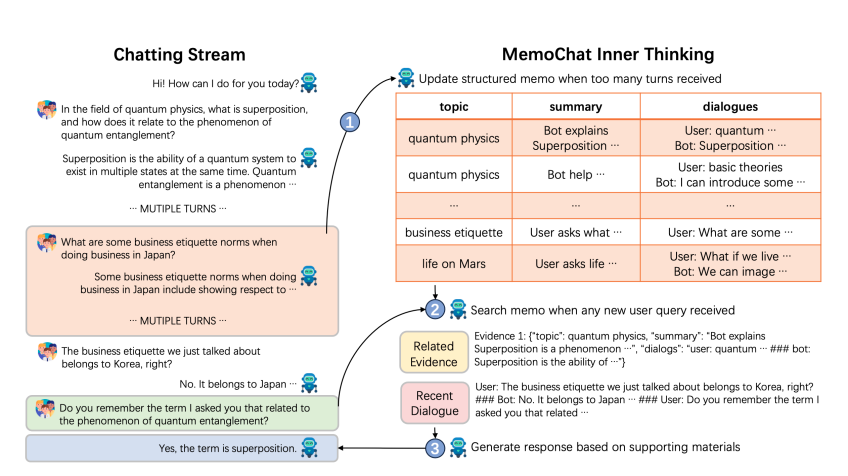

「MemoChat」の研究者たちは、LLMが長い会話で一貫性を保つ課題に対して、新しいアプローチを提案しています。彼らのアイデアは、人間が会話を行う際に自然に行う「メモ取り」のプロセスを模倣することに基づいています。

このアプローチでは、LLMが会話をトピックごとに細分化し、それぞれのトピックに関連する要点を「構造化されたメモ」として記録します。このメモは、後の会話で参照され、一貫性のある応答を生成するための基盤となります。

人間の記憶との類似性

この方法は、人間が複雑な情報を処理する際に使用する記憶の仕組みに似ています。人間は、情報をカテゴリーに分け、重要なポイントを記憶することで、後でその情報にアクセスできるようにします。MemoChatは、この人間のプロセスを模倣して、LLMに同様の能力を提供します。

従来のチャットボットは、大規模なデータベースから適切な応答を「検索」するアプローチを取ることが一般的でした。しかし、MemoChatは、過去の会話から「学ぶ」ことに焦点を当て、より人間らしい、一貫した対話を可能にします。