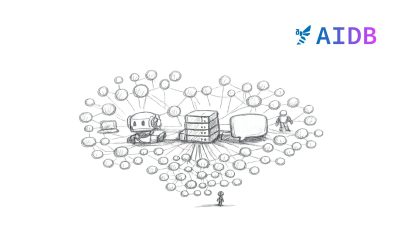

Appleの研究者らは、LLMのパラメータをSSDなどの外部フラッシュメモリに保存し、接続したPCなどで読み込み使用する手法を開発しました。

CPUで4-5倍、GPUで20-25倍の推論速度向上が実現し、さらにPCデバイスの記憶容量がモデルサイズの半分でも、LLMを高効率に実行できたとのことです。

– “LLM in a Flash: Efficient Large Language Model Inference with Limited Memory”

■研究に至る背景

LLMは高性能だが、計算負荷が重く、要求されるメモリーも高いため、デバイスを選ぶ

■今回開発された手法のポイント

① モデルパラメータを外部フラッシュメモリに格納

② 要求に応じてPCのDRAM(メモリ)に転送

③ データ転送量を減らし推論速度を向上

■テクニカルな点

① 計算済みのトークン活性化を再利用

② フラッシュメモリの連続データアクセスを活用

■実験

① Apple M1 MaxやNVIDIA GeForce RTX 4090を使用

② OPT 6.7BとFalcon 7Bモデルを実行

③ 推論速度とメモリ使用効率を検証

■結果

① CPUで4-5倍、GPUで20-25倍の推論速度向上を実現

② PCデバイスメモリ(DRAM)がモデルサイズの半分でも、LLMを高効率に実行

なお、DRAM(メモリ)内のデータ管理が効率的でないと、性能向上の効果が減少することに注意すべきと述べられています。