「特定のキャラ」を再現してさまざまな画像生成を行う技術『The Chosen One』が開発されました。

通常のいわば一期一会のような人物生成における一貫性の欠如を解決するものです。

Googleなどの研究者らによる発表です。

@ Omri Avrahami et al., “The Chosen One: Consistent Characters in Text-to-Image Diffusion Models”

論文によると、テキストプロンプトによる画像生成において、一貫したキャラクターの生成が困難でした。

創作、アセットデザイン、広告などにおいて、キャラクターの再生成は重要です。

そこで研究者らはプロンプトと生成物に一貫性を持たせる最優秀な手法を開発したとのことです。

■『The Chosen One』のポイント

① プロンプトのみから一貫したキャラを生成

② 生成した画像を特徴でクラス分け

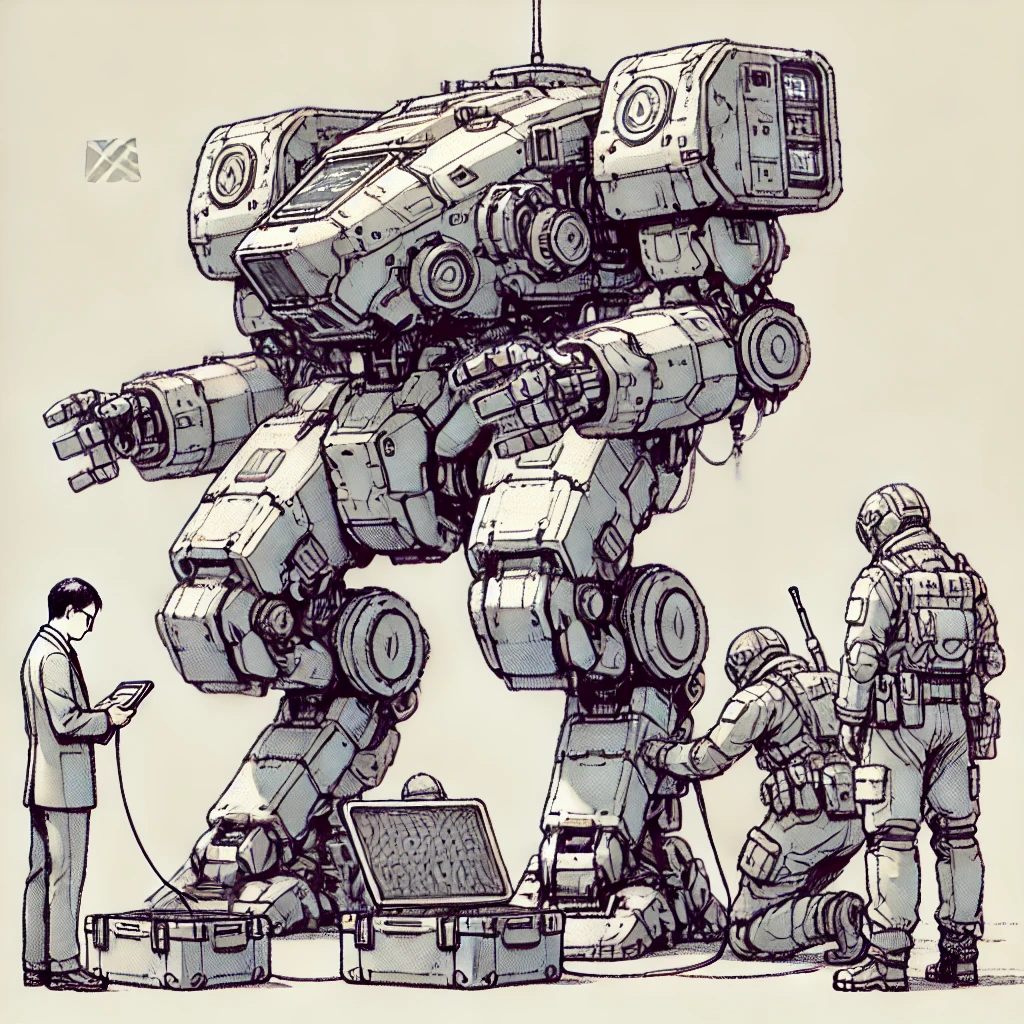

③ さまざまな実用可能性を見据える

■実験と結果

① DALL-E3と本手法を用いてキャラを生成

② 多数の生成を行い結果をレーティング

③ 異なる初期シードを使用

④ プロンプトに対応する異なるキャラクターを一貫して生成できることを確認

■具体的な方法

※技術的な操作を含みます。

① プロンプトでキャラを生成

② DALL-E3などを使用して、同一のプロンプトに基づいて複数の画像を生成

③ 生成された画像を意味的特徴空間でクラスタリング

④ 共有特徴を持つ最も一貫したグループを特定

⑤ 選択された画像グループに基づいてキャラクターの表現を洗練

⑥ 特定の特徴(例:顔の特徴、服装)を強調

⑦ 改善された表現を使用して新たな画像を生成

⑧ 再度クラスタリングと洗練のプロセスを行う

上記を複数繰り返すとキャラの一貫性が向上するとのことです。

つまり、洗練されたキャラクター表現を用いて、異なる文脈や背景設定で同じキャラクターを生成できるようになるとのことです。