GPT-4などのLLMがタスクごとに適切な推論プロセスを自ら考えて実行できるようにするためのプロンプト手法が、Google DeepMindなどの研究者らによって考案されました。

従来の手法より最大42%性能が向上し、計算が10~40倍少なくなることを確認したとのことです。

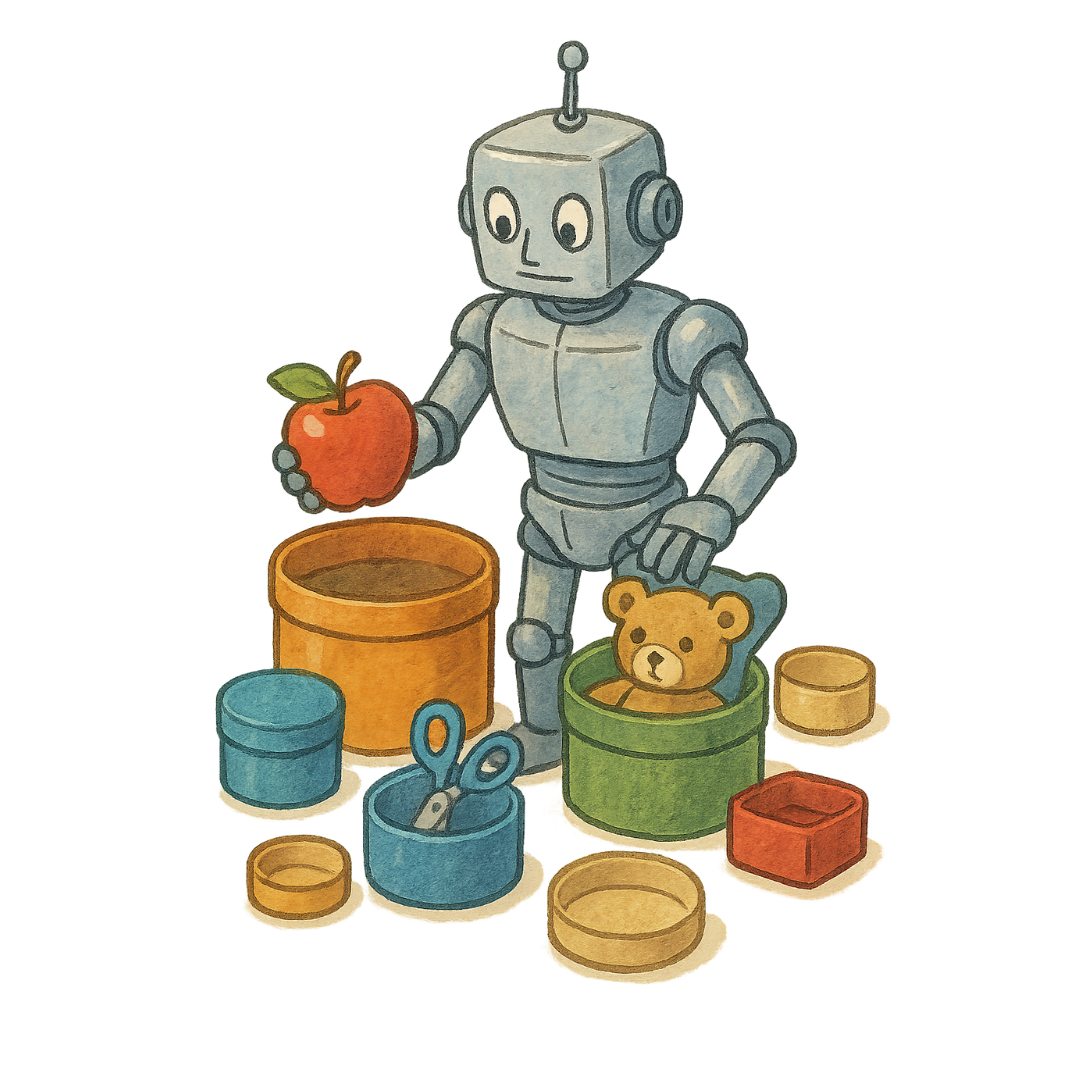

“Self-Discover: Large Language Models Self-Compose Reasoning Structures”より

(1時間ほど前のポスト内容を修正するために再度投稿しています。主にプロンプトテンプレートを再構成しました)

■背景、課題

– LLMの問題解決能力は性能向上が求められている

– これまでのプロンプト手法は、タスクごとに内在する推論プロセスをカバーできていない

– 一方で、タスクごとにプロンプトを細かく組み立てるアプローチは非効率的

■アプローチ

下記のようなプロンプトテンプレートを使用して、LLM自身にタスクに合った推論プロセスを考えさせます。

(※論文内容をもとに当編集部が具体化した例です)

入力プロンプト:

「この問題は、〜〜に関連しています。解決するには、深い推論と分析が必要です。」

「推論プロセスを開始するために、まずは問題を理解し、解決に向けて必要なステップを特定してください。」

「考えられる推論モジュールを複数挙げ、それぞれがこのタスクにどのように貢献するかを検討してください。」

「自己発見した推論構造に基づいて、複数のステップで問題を解決してください。ステップごとに、具体的なアクションや考え方を明示してください。」

「先ほど定義したステップを具体的に実行して問題の解決に必要な計算や分析を行った結果得られた、最終的な推論と解答を生成してください。」

■実験と結果

– GPT-4/3.5/PaLM2-L/Llama2-70Bに適用して評価

– Big Bench-Hard (BBH)、Thinking for Doing (T4D)、MATHなど、25の難易度の高い推論タスクでテスト

– 21/25のタスクでCoTを上回り、最大42%のパフォーマンス向上を達成した

– 計算を10-40倍少なくした

– 世界知識を必要とするタスクで最も高い性能を発揮した

なお数学タスクでは、モデルの初期応答における失敗の74.7%が計算エラーから来ていることが明らかにされたと述べられています。